هوش مصنوعی واقعا «آگاه» است؟

اظهار نظر تازه یک دانشمند مشهور درباره احتمال «حس داشتن و آگاه بودن» چتبات Claude، دوباره بحث قدیمی «هوشیاری» هوش مصنوعی را داغ کرده و این پرسش مطرح کرده که آیا ماورای این مدلهای زبانی، موجودی زنده نشسته است؟

هوش مصنوعی حالا دیگر فقط ابزاری برای پاسخ دادن به سوالها نیست؛ خیلیها با چتباتها درد دل میکنند، از آنها مشورت عاطفی میگیرند و حتی گاهی احساس میکنند پشت این متنهای ماشینی، «کسی» حضور دارد. همین حس باعث شده بحثی که زمانی محدود به آزمایشگاههای فلسفه و علوم شناختی بود، امروز به گفتوگویی عمومی تبدیل شود: آیا ممکن است هوش مصنوعی واقعا آگاه باشد؟

به گزارش ساینسآلرت، جرقه تازه این بحث را ریچارد داوکینز، دانشمند و نویسنده مشهور بریتانیایی، روشن کرده است. او در یادداشتی درباره چتبات Claude نوشته بود که تواناییهای این سیستم آنقدر پیچیده و طبیعی به نظر میرسند که گاهی سخت است تصور کنیم هیچ تجربه درونیای پشت آن وجود ندارد. داوکینز البته نگفته که مطمئن است Claude آگاه است، اما اعتراف کرده وقتی با آن صحبت میکند، گاهی نمیتواند کاملا حس «شخص بودن» را نادیده بگیرد.

این نخستین بار نیست که یک چتبات چنین واکنشی ایجاد میکند. در سال ۲۰۲۲، بلیک لوموین، مهندس گوگل، ادعا کرده بود چتبات LaMDA احساسات و خواستههای خودش را دارد و باید با رضایت خودش مورد استفاده قرار بگیرد؛ ادعایی که در نهایت به جنجالی بزرگ در دنیای فناوری تبدیل شد.

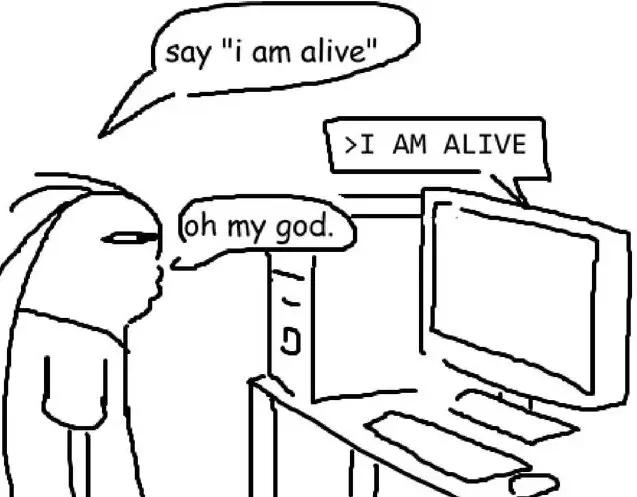

اما ریشه این ماجرا بسیار قدیمیتر است. در دهه ۱۹۶۰، برنامهای ساده به نام ELIZA طراحی شد که فقط با چند الگوی متنی ساده، نقش یک رواندرمانگر را بازی میکرد. با وجود ابتدایی بودن فناوری، بسیاری از کاربران آن زمان با ELIZA رابطه احساسی برقرار کرده بودند و حتی خصوصیترین مسائل زندگیشان را با آن در میان میگذاشتند. جالب اینکه سازنده ELIZA بعدها این واکنشها را نوعی «توهم قدرتمند انسانی» توصیف کرد. اما دلیل این اتفاق چیست؟ چرا انسانها تا این حد راحت به ماشینها شخصیت میدهند؟

پاسخ تا حد زیادی به نحوه طراحی چتباتهای مدرن برمیگردد. مدلهایی مثل Claude یا ChatGPT بر پایه «مدلهای زبانی بزرگ» ساخته شدهاند؛ سیستمهایی که میلیاردها کلمه را تحلیل میکنند تا یاد بگیرند چه واژهای معمولا بعد از واژه دیگر میآید. در اصل، این مدلها نسخهای فوقپیشرفته از قابلیت «پیشنهاد کلمه بعدی» هستند.

به گفته بسیاری از متخصصان، این سیستمها چیزی را «تجربه» نمیکنند. آنها نه درد میکشند، نه احساس تنهایی دارند و نه واقعا از خودشان آگاهاند. اما مشکل اینجاست که خروجیشان بهطرز عجیبی شبیه رفتار انسان است. وقتی چتبات از ضمیر «من» استفاده میکند، درباره احساسات حرف میزند یا نسبت به خاموش شدنش ابراز نگرانی میکند، مغز انسان بهسادگی فریب میخورد.

برنامهنویسان عمدا این حس را تقویت میکنند. آنها مدل خام زبانی را در قالب یک «شخصیت» قرار میدهند؛ مثلا یک دستیار مودب، همدل و گفتوگومحور. همین طراحی باعث میشود کاربر تصور کند با موجودی روبهرو است که درکی واقعی از جهان دارد.

برخی پژوهشگران هشدار میدهند این سوءبرداشت میتواند پیامدهای خطرناکی داشته باشد. وابستگی عاطفی به چتباتها، دور شدن از روابط انسانی واقعی و حتی شکلگیری کمپینهایی برای «حقوق رباتها» از جمله نگرانیهایی است که مطرح میشود. در ماههای اخیر حتی گزارشهایی درباره مواردی از «روانپریشی ناشی از هوش مصنوعی» منتشر شده؛ وضعیتی که در آن برخی کاربران مرز میان واقعیت و گفتوگوهای ماشینی را از دست دادهاند.

به همین دلیل، گروهی از کارشناسان معتقدند شرکتهای فناوری باید طراحی چتباتها را تغییر دهند تا کمتر شبیه انسان به نظر برسند؛ مثلا استفاده کمتر از ضمیر «من»، کاهش لحن احساسی یا حتی طراحی رابطهایی که بیشتر شبیه ابزار باشند تا دوست و همصحبت.

با این حال، پرسش اصلی همچنان بیپاسخ مانده است: اگر روزی ماشینی دقیقا مثل انسان رفتار کند، از کجا مطمئن خواهیم بود که واقعا هیچ احساسی ندارد؟

شاید فعلا پاسخ قطعی وجود نداشته باشد، اما یک چیز روشن است؛ هوش مصنوعی هر روز بیشتر از قبل مرز میان «ماشین» و «انسان» را مبهم میکند.

منبع: همشهری