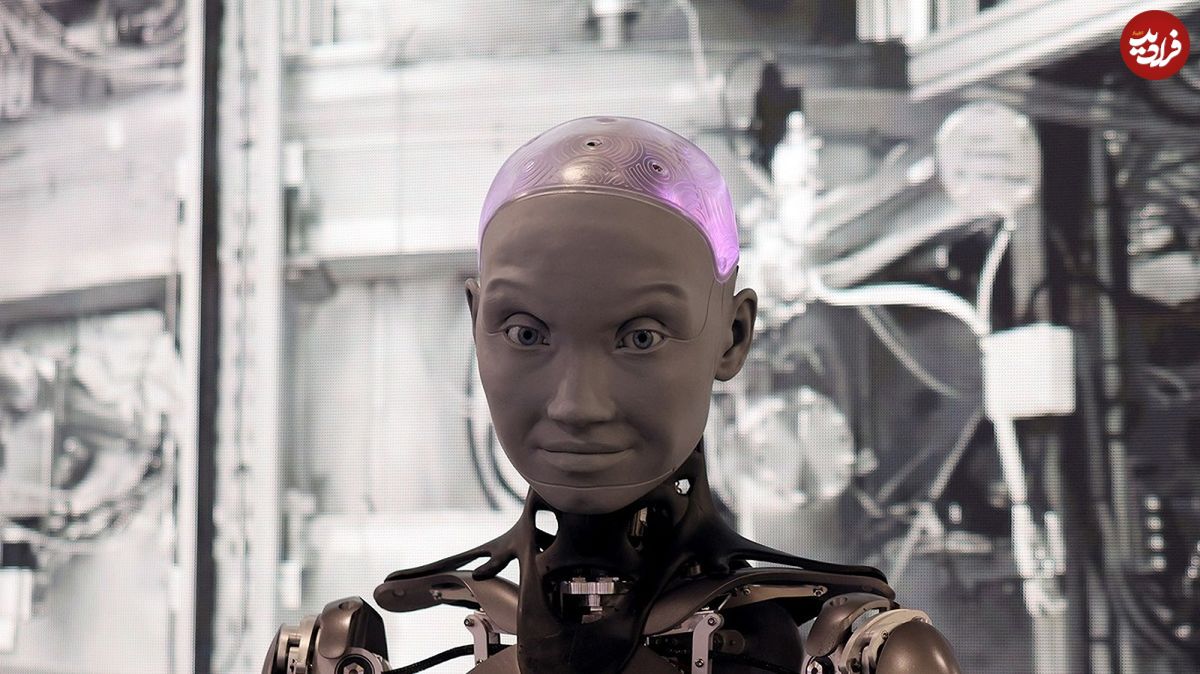

آیا روباتها صاحب حق هستند؟

شاید رفتاری که انسانها در قرن بیست و یکم با رباتها دارند، برای آیندگان چیزی نفرتانگیز و ترسناک به نظر برسد!

فرادید | وقتی دربارهی حقوق و رفاه حیوانات صحبت میکنیم، معمولاً به دو ایده اشاره میشود: ادارک و هوش؛ اما وقتی صحبت از روباتها و هوش مصنوعیِ پیشرفته میشود، این دو ایده به طرز عجیبی از معادله خارج میشوند. شاید ما در یک آستانهی تکنولوژیکی میان «هوش مصنوعی» و «هوش مصنوعی عالی مقام» هستیم. شاید وقت آن رسیده است که بیشتر دربارهی حقوق روباتها صحبت کنیم.

به گزارش فرادید ، سال ۲۰۱۰، اتحادیهی اروپا یک دستورالعمل قانونی با عنوان «دربارهی حفاظت از حیواناتی که برای اهداف علمی از آنها استفاده میشود» صادر کرد. این دستورالعمل توضیح میدهد از کدام حیوانات باید حفاظت خاص صورت گیرد و ۲۷ کشور عضو اتحادیهی اروپا را ملزم میکند که از قوانین خاصی برای گرفتن حیوانات و آزمایش کردن روی آنها پیروی کنند. طبق این دستورالعمل، هر عملی که این حیوانات را دچار درد، رنج یا پریشانی شدید کند و اثر آن بلندمدت باشد و نتوان آن را بهبود بخشید، ممنوع است. افزون بر این، تمام آزمایشات مستلزم مطالعاتِ امکانسنجیِ مستقل برای اثبات ضرورت استفاده از حیوانات در تحقیقات هستند. در این فهرست، نخستیها، بیشترِ پستانداران و بسیاری از مهرهداران هستند. نکتهی جالب اینجاست که سیکلوستومها (جانورانی از راستهی دهانگردان) و سَرپایان (ردهای از نرمتنان) نظیر اختاپوسها به عنوان مهرهداران افتخاری در این فهرست گنجانده شدهاند.

در حالی که این دستورالعمل به روشنی بیان میکند که «تمام حیوانات ارزش ذاتی دارند»، این سند اساساً دربارهی ارزشمندتر بودن برخی از حیوانات نسبت به حیوانات دیگر است. اما اگر قرار باشد گونهها را رتبهبندی کنیم از چه معیاری باید استفاده کنیم؟ اگر صفی طولانی از حیوانات را تجسم کنید، از جانواران تکسلولی گرفته تا انسانها، در چه نقطهای از این صف خط میکشید و میگویید: «از اینجا به بعد، حیوانات حقوق خودشان را دارند»؟ این مسئلهای است که در مورد حوزهی بسیار پیچیدهتری هم کاربرد دارد: حقوق روباتها. در اینجا نیز میتوانیم خط مشابهی بکشیم. از یک سو ماشینحسابها هستند و از سوی دیگر هوش مصنوعی برتر و همهچیزدانِ علمیتخیلی. این خط کجا قرار خواهد گرفت؟ چه زمانی کامپیوتر صاحب حق خواهد شد و چه زمانی روبات فردیت خواهد یافت؟

بردگان آینده

در بیشتر داستانهای علمیتخیلی، روباتها به شکل بردگان یا منابعی به تصویر کشیده میشوند که از آنها بهرهبرداری میشود. آنها اگر هم حقی داشته باشند، کمتر از هوموسَپییِنسها است. در جنگ ستارگان، روباتهای انساننما از زبان استفاده میکنند، برنامهریزی میکنند و به ظاهر از چیزهای مختلفی دچار پریشانی میشوند و رفتار با آنها دستکمی از رفتار با بردگان ندارد. بدلهای «بلِید رانِر» (غیرقابلتشخیص از انسانهای «واقعی») ناچار به کار کردن به عنوان سرباز یا بردهی جنسی هستند. «پیشتازان فضا» (سفر ستارهای) حتی یک اپیزود کامل را به این پرسش اختصاص میدهد که آیا دِیتا میتواند مسیر زندگی خودش را انتخاب کند. در مجموع، داستانهای علمی تخیلی دنیایی را به تصویر میکشند که در آن روباتها هیچ حق و حقوقی ندارند.

دلیلش این است که همهی ما با یک قطعِ ارتباط احساسی با روباتها بزرگ شدهایم. آنها را جدا از خودمان و متفاوت میدانیم. این هنجار عصر ما است که با کامپیوتر و هوش مصنوعی به عنوان اشیایی که باید از آنها استفاده کرد، برخورد کنیم. رفاه آنها، انتخابهای آنها و زندگی آنها برای ما موضوعات کماهمیتی هستند. همهی اینها یک تناقض اخلاقی عجیب است. در اسناد حقوقی-اخلاقی ما (مانند همین دستورالعمل اتحادیهی اروپا) معمولاً به دو چیز اشاره میشود: ادراک و هوش. ما هر دوی این ویژگیها را به حیواناتی با درجات مختلف نسبت میدهیم. ما نمیدانیم آنها این درجات را دارند یا نه، اما فرض ما بر این است که دارند. حتی در دستورالعمل اتحادیهی اروپا قید شده است: «همیشه باید با حیوانات به عنوان موجودات دارای شعور رفتار کرد.». معنایش این نیست که آنها واقعاً صاحب شعور هستند بلکه به این معنا است که ما باید به گونهای با آنها رفتار کنیم که گویی صاحب شعور هستند. پس چرا همین حق را برای هوش مصنوعی قائل نمیشویم؟

آزمون تورینگ معکوس

آزمون تورینگ آزمایش معروفی است که در آن کاربران انسانی از هوش مصنوعی سوالاتی میپرسند تا مشخص شود آیا غیرقابلتشخیص از انسان هست یا نه. این سوال دربارهی هوش و تقلید است. اما چه میشود اگر اصول این آزمون را کاملاً برعکس کنیم و «آزمون تورینگ حقوق روبات» بسازیم و این سوال را بپرسیم: «روبات چه چیزی دارد که آن را از حقوق، حمایت و احترام محروم میکند؟» واقعاً چه چیزی روباتها را از انسانها مجزا میکند؟

در ادامه سه پیشنهاد احتمالی و پاسخ آنها را میخوانید.

۱. روباتها فاقد هوش پیشرفته و تعمیمیافته (عقل) هستند. این قطعاً درست است، البته در حال حاضر! برای ماشینحساب شما کار با π و cos (x) مثل آب خوردن است، اما در خواندن علائم جاده نمیتواند به شما کمک کند. دستیار صوتی در اطلاعرسانی دربارهی آب و هوا خوب عمل میکند، اما نمیتواند با شما مکالمه داشته باشد. اگرچه این مخالفت سه ایراد دارد. نخست اینکه حیوانات زیادی وجود دارند که هوش زیادی ندارند، اما به آنها احترام میگذاریم و با آنها خوب رفتار میکنیم. دوم اینکه انسانهایی فاقد هوش پیشرفته داریم مثل نوزادان یا کسانی که دچار ناتوانیهای ذهنی شدید هستند با این حال برای آنها حقوقی قائل هستیم. سوم اینکه با توجه به سرعت پیشرفت هوش مصنوعی، ما در آستانهای هستیم که شاید به زودی قادر به عبور از آن باشیم. آیا ما واقعاً آمادهی رها کردن کامپیوترها از قید و بند و رفتار کردن با آنها درست مثل انسانها هستیم؟

۲. روباتها نمیتوانند احساساتی مانند درد یا عشق را حس کنند (توانمندی ادراک حسی). این یک حوزهی پیچیده است به ویژه به این دلیل که ما به طور کامل نمیدانیم احساسات چه هستند. در یک سطح فیزیکال، اگر احساسات را به هورمونها یا واکنشهای الکتروشیمیایی در مغز تنزل دهیم، پس این امکان وجود دارد که بتوانیم آن را در هوش مصنوعی بازتولید کنیم. در این صورت، میتوان به روباتها حقوق قانونی/اخلاقی داد؟ مسئلهی دیگر این است که در اینجا همچنان یک تعصب انسان-محور وجود دارد. اگر دوست شما گریه کند، شما او را غمگین فرض میکنید نه اینکه او غمگین بودن را تقلید میکند. وقتی هوش مصنوعی، احساسی را نشان میدهد (بیشتر در فیلمهای علمی تخیلی) چرا فرض میکنیم این کار چیزی بیش از تقلید نیست؟

۳. روباتها توسط انسانها ساخته و برنامهریزی شدهاند. حتی وقتی یک هوش مصنوعی پیشرفته میتواند از موقعیتها بیاموزد، هنوز به میزان زیادی به هدایت شدن توسط انسان در قالب برنامهریزی احتیاج دارد. چیزی که تا این حد به عاملیت انسان وابسته است را نمیتوان شایستهی حق دانست. این دیدگاه دو مشکل دارد. نخست اینکه در حالی که ما دربارهی انسانهای «برنامهریزیشده» صحبت نمیکنیم، اغراق نیست اگر بگوییم این دقیقاً همان کاری است که ژنهای ما هم انجام میدهند. ما به زبان ساده نتیجهی سیمکشیِ ژنتیکیِ خودمان و درونگذاشتِ اجتماعی-والدینی خودمان هستیم. پس فرق زیادی با هوش مصنوعی نداریم. دوم اینکه، چرا وابستگی هوش مصنوعی به انسان باید او را از حقوقش محروم کند؟ سگها، بچهها و سالمندان هم به دیگران وابسته هستند، با این حال ما اجازه نمیدهیم از آنها سوءاستفاده یا با آنها بدرفتاری شود (در حاشیه بگوییم که استدلالِ وابستگی=بردگی نخستین بار توسط ارسطو مطرح شد).

جنبهی اشتباه تاریخ

دو پرسش وجود دارد که درون یک مسئلهی بزرگ از نظر پنهان ماندهاند. نخستین پرسش این است که آیا هوش مصنوعی شایستهی فردیت است؟ این پرسش در حال حاضر پرسش پیچیدهای است و شاید هرگز نتوان پاسخ رضایتبخشی به آن داد. دومین پرسش این است که در چه نقطهای هوش مصنوعی شایستهی این است که با احترام و توجه با آن رفتار شود؟ چه زمانی دیگر نمیتوانیم از روباتهای پیشرفته سوءاستفاده یا با آنها بدرفتاری کنیم؟

این احتمال وجود دارد که نسلهای آینده نگاه بهتزدهای به رفتار ما کنند. اگر آیندهای را تصور کنیم که در آن با هوش مصنوعیِ دارایِ ادراک و عقل مانند انسانها رفتار میشود، این تصور نیز دور از ذهن نیست که آنها چقدر از فکر کردن به عصر ما شگفتزده خواهند شد. اگر روباتهای قرن بیست و دوم بتوانند دوستان، همکاران و همبازیهای ما باشند، آیا موضوعِ بهرهکشیِ قرن بیست و یکم از هوش مصنوعی یک موضوع عجیب نخواهد بود؟

شاید ما در آستانهی «هوش مصنوعی محترم» هستیم. هیچکس برای حقوق ماشینحساب کارزار به راه نمیاندازد، اما شاید وقت آن رسیده است که نوع نگاهمان به هوش مصنوعیِ تعمیمیافته و شگفتانگیزی را که ساختۀ خودمان است دوباره ارزیابی کنیم.

منبع: Bigthink

مترجم: زهرا ذوالقدر