فیزیک عجیبی که مغز ماشین را بیدار کرد

در دهه ۱۹۸۰، زمانی که دانشمندان هنوز تصویری روشن از چگونگی ساخت ماشینهایی با توانایی یادگیری نداشتند، یک فیزیکدان حالتجَمَد به نام جان هاپفیلد، روشی نوآورانه برای ساخت حافظه در ماشینها ارائه کرد. او با الهام از رفتار عجیب موادی موسوم به «شیشههای اسپینی» (Spin Glasses)، مدلی از شبکههای عصبی ساخت که میتوانستند اطلاعات را ذخیره و بازیابی کنند، بدون نیاز به جستوجو در حافظه یا پایگاه داده.

هوش مصنوعی مدرن، میراث فیزیکی از موادی است که هیچکس فکر نمیکرد به کار آیند: شیشههای اسپینی.

در دهه ۱۹۸۰، زمانی که دانشمندان هنوز تصویری روشن از چگونگی ساخت ماشینهایی با توانایی یادگیری نداشتند، یک فیزیکدان حالتجَمَد به نام جان هاپفیلد، روشی نوآورانه برای ساخت حافظه در ماشینها ارائه کرد. او با الهام از رفتار عجیب موادی موسوم به «شیشههای اسپینی» (Spin Glasses)، مدلی از شبکههای عصبی ساخت که میتوانستند اطلاعات را ذخیره و بازیابی کنند، بدون نیاز به جستوجو در حافظه یا پایگاه داده.

اگرچه شیشههای اسپینی در ظاهر بیفایده به نظر میرسند، نظریههای فیزیکیِ ابداعشده برای توضیح رفتار غیرمعمول آنها، بذر شبکههای عصبی هوشمند امروز را کاشتند. این شبکهها بعدها زیربنای انقلاب یادگیری عمیق و مدلهای زبانی بزرگی مانند ChatGPT شدند.

در سال ۲۰۲۴، جان هاپفیلد به همراه جفری هینتون، دیگر پیشگام عرصه هوش مصنوعی، جایزه نوبل فیزیک را به خاطر پژوهشهایشان در زمینه فیزیک آماری شبکههای عصبی دریافت کردند؛ جایزهای که برخی آن را بیشتر یک افتخار برای هوش مصنوعی دانستند تا فیزیک. با این حال، دانش پشت این فناوری همچنان عمیقاً فیزیکی باقی مانده است، فیزیکی که حالا نهفقط برای حافظه، بلکه برای تخیل ماشینها نیز به کار میآید.

جرقهای از دل یک مشکل واقعی

جان هاپفیلد، فیزیکدان آمریکایی، مسیر علمیاش را با مطالعه نیمههادیها آغاز کرد، اما به گفته خودش، در اواخر دهه ۱۹۶۰ دیگر «مسئلهای که بتواند به آن معنا ببخشد» پیدا نمیکرد. پس از ورود کوتاهمدت به زیستبیوشیمی، او به سوی علوم اعصاب و پرسشی بنیادین کشیده شد: ذهن چگونه از مغز پدید میآید؟

او متوجه شد که مفهوم «حافظه تداعیگر»، یعنی بهیادآوردن چیزها از طریق نشانهها و تداعیها، مسئلهای است که میتوان با ابزارهای فیزیک آماری سراغش رفت. برخلاف حافظه دیجیتال رایانهها که مبتنی بر آدرسدهی دقیق است، حافظه انسانی با یک بو، صدا یا تصویر ناقص فعال میشود. هاپفیلد به دنبال مدلی رفت که بتواند چنین سازوکاری را بازسازی کند.

شیشههای اسپینی: بینظم، ولی هوشمند

مواد موسوم به «شیشههای اسپینی» در دهه ۱۹۵۰ بهواسطه رفتار مغناطیسی عجیبشان مورد توجه فیزیکدانها قرار گرفتند. برخلاف آهنرباهای معمول، این مواد در دمای پایین خاصیت مغناطیسی گذرایی را حفظ میکنند و انرژی آنها در وضعیتهای مختلف میتواند در حالتهای گوناگون گیر کند، مثل تپهماهورهایی پر از درههای عمیق و کمعمق.

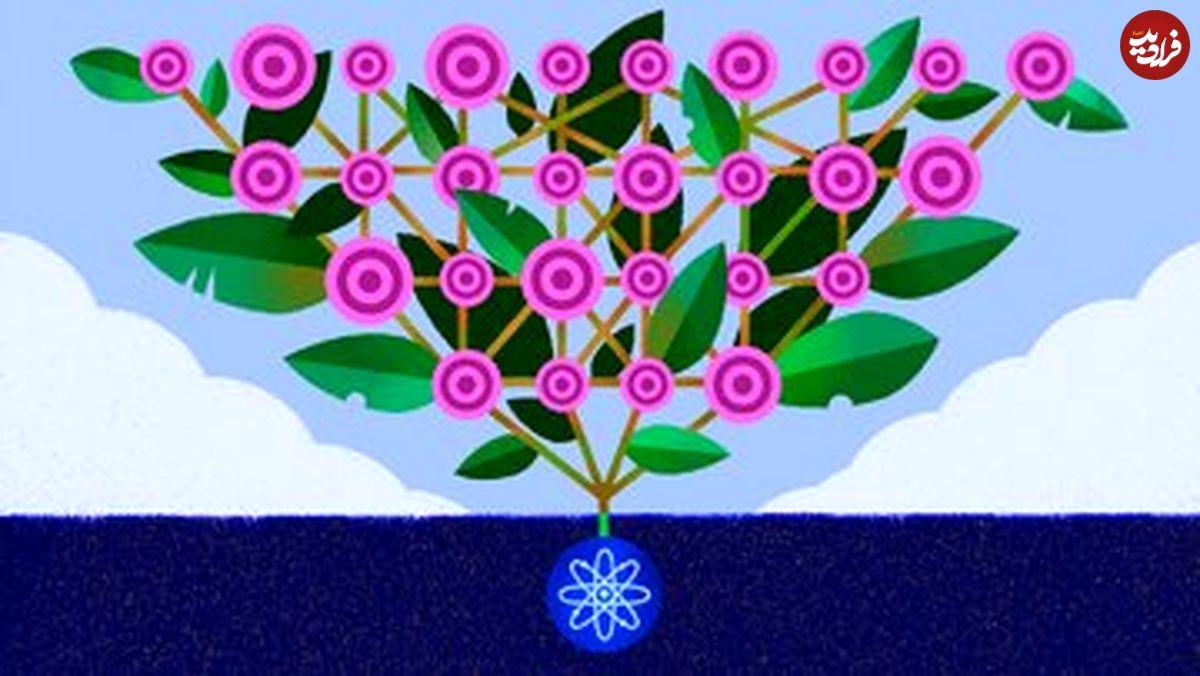

این وضعیت، که «چشمانداز انرژی» نام دارد، به فیزیکدانها اجازه داد مدلی آماری برای توصیف چنین سیستمهای پیچیدهای بسازند. هاپفیلد نیز از همین ایده برای مدلسازی حافظه استفاده کرد: اگر بتوانیم درههای انرژی را طوری شکل دهیم که هرکدام نماینده یک الگو یا خاطره باشند، شبکه عصبی بهطور طبیعی به سمت آنها «سرازیر» میشود.

از مغناطیس تا ماشینهای مولد

در ادامه، هاپفیلد شبکهای از نورونهای مصنوعی طراحی کرد که هرکدام میتوانستند در وضعیت «روشن» یا «خاموش» باشند. با تغییر شدت تعامل بین نورونها، او موفق شد الگوهایی را در حافظه این شبکهها بنشاند. هر بار که بخشی از اطلاعات به شبکه داده میشد، مثلاً تصویری ناقص از یک گربه، شبکه با تکمیل تدریجی آن بهسوی یادآوری کامل الگو میرفت؛ مانند انسان که با شنیدن ابتدای یک ترانه، ادامه آن را به خاطر میآورد.

جفری هینتون در دهه ۱۹۸۰ با توسعه این ایدهها، مدل بولتزمان را معرفی کرد که اساس شبکههای یادگیرنده و در نهایت یادگیری عمیق را شکل داد. با ورود به دهه ۲۰۱۰، شبکههای عصبی عمیق به چنان موفقیتی دست یافتند که صنعت فناوری را متحول کردند.

بازگشت دوباره مدلها

در سالهای اخیر، پژوهشگران دریافتهاند که مدلها و اصول هاپفیلد هنوز حرفهایی برای گفتن دارند. در سال ۲۰۲۰ مشخص شد بخشی از ساختار «ترنسفورمر»ها، یعنی همان معماری پشت مدلهایی مثل GPT، عملاً نوعی شبکه هاپفیلد مدرن هستند. این کشف الهامبخش معماریهای تازهای مانند «ترنسفورمر انرژی» شد؛ مدلی که بهجای اتکا بر آزمون و خطا، با طراحی آگاهانه «چشمانداز انرژی» ساخته میشود.

همچنین مدلهای تولیدی مانند Midjourney، که با افزودن و حذف نویز به تصاویر کار میکنند، از اصول مشابهی با شبکههای هاپفیلد استفاده میکنند. پژوهشگران نشان دادهاند که این مدلها با بزرگتر شدن دادهها، نهتنها فراموش نمیکنند، بلکه شروع به خلق «خاطرات جعلی» میکنند، درست مانند مدلهای پخش یا Diffusion.

از فیزیک تا فهم ماشینها

ظهور رفتارهای «برآمده» یا Emergent در شبکههای یادگیری عمیق، همچنان یکی از رازهای ناشناخته علم است. این پدیدهها از دل تعاملات جمعی ساده بهوجود میآیند و فیزیک آماری یکی از معدود ابزارهایی است که توانسته تصویری از آنها ارائه دهد.

شاید در آینده، همانطور که فیزیک به فهم حافظه مصنوعی کمک کرد، بتواند رازهای پیچیدهتری مانند خلاقیت و ادراک را نیز در ماشینها آشکار کند.

منبع: خبرآنلاین