چرا «تامکروزدیپ-فیک» کارشناسان را ترسانده است؟

دیپفیک یا جعل عمیق در سال ۲۰۱۴ و توسط ایان گودفلو، که مدیر یادگیری ماشینی در گروه پروژههای ویژه شرکت اپل و یکی از رهبران این رشته بود، اختراع شد. این اصطلاح از ترکیب اصطلاح «یادگیری عمیق» deep learning و «جعلی» fake درست شده و درواقع شکلی از هوش مصنوعی است. «زنان همین حالا هم توسط دیپفیکها هدف قرار میگیرند. درواقع اینکه "دیگر نمیتوان آنچه را با چشم دید، باور کرد" باعث میشود که ویدیوهای واقعی اهمیت خود را از دست بدهند.»

کد خبر :

۹۱۲۵۵

بازدید :

۱۱۵۵۹

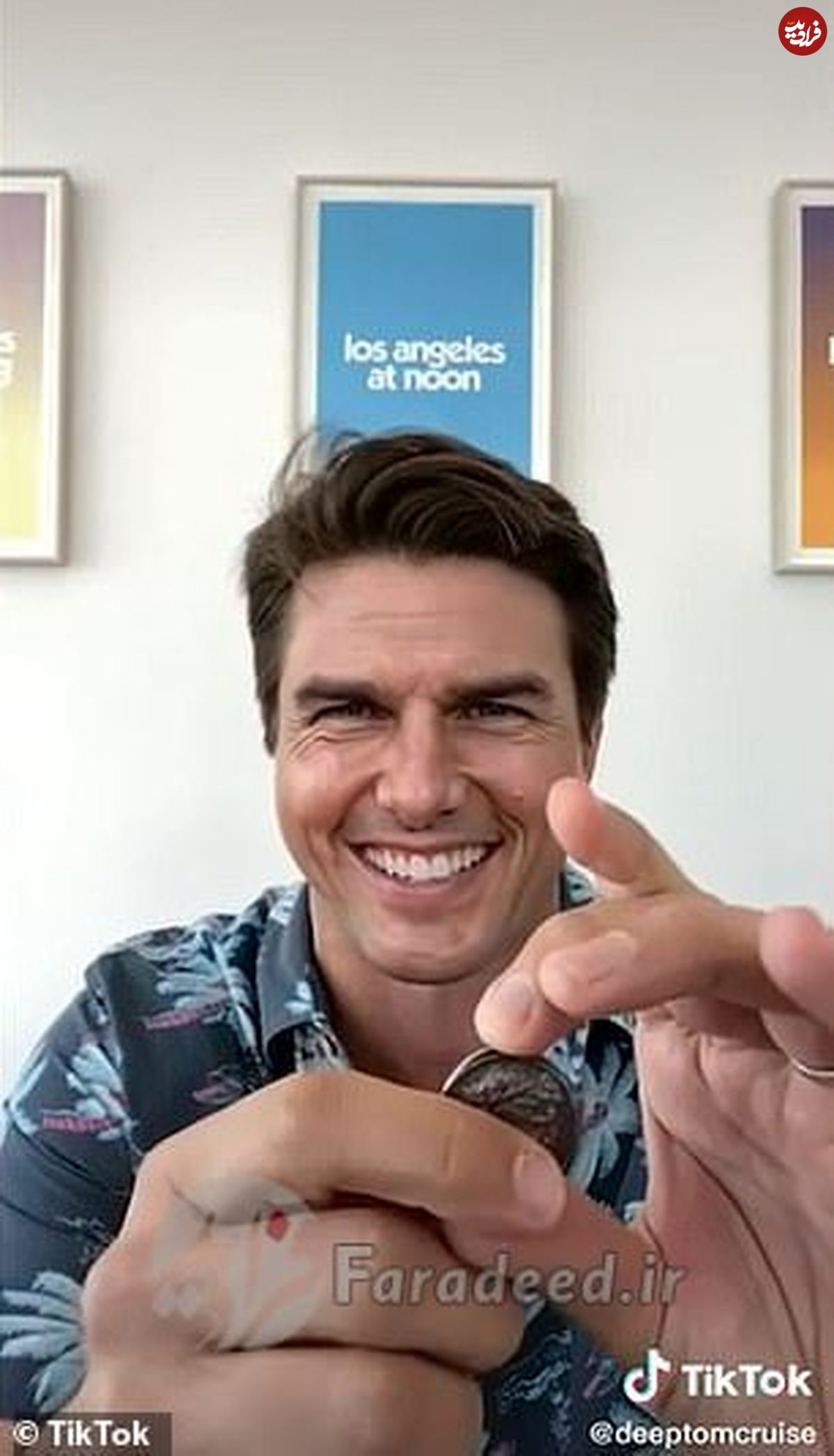

فرادید | ویدیوی تام کروز، بازیگر معروف هالیوودی، در نرمافزار تیکتاک که یک نرمافزار به اشتراکگذاری ویدیو است، وایرال شده، اما درواقع این ویدیوها، مربوط به تصویر بازیگر «مأموریت غیرممکن» نیست بلکه دیپفیکها یا جعل عمیقهایی است که کارشناسان آنها را «هشداردهندهترین نمونههای بهنظر واقعی» از این تکنولوژی نامیدهاند.

فرادید به نقل از دیلیمیل گزارش داد، هفته گذشته در تیکتاک حساب کاربریای با عنوان «دیپتامکروز» ساخته شد که حاوی تعدادی ویدیوست که این بازیگر را در حال انجام تردستی، بازی گلف و خاطره تعریف کردن درباره ملاقاتش با رئیسجمهور پیشین اتحاد جماهیر شوروی نشان میدهد.

این مجموعه ویدیو طی چند روز ۱۱ میلیون بار دیده شده و نهتنها در تیکتاک بلکه در سایر پلتفرمهای رسانههای اجتماعی قابل دسترس است. اگرچه این ویدیوها با هدف سرگرمی تولید شدهاند، اما کارشناسان هشدار دادهاند که چنین محتواهایی «مایه نگرانی ماست.»

سم گرگوری، برنامهنویس در سایت ویتنس. او آرجی، نگرانی خود درباره دیپفیکهای تام کروز را در توئیتر به اشتراک گذاشت و نوشت: «زنان همین حالا هم توسط دیپفیکها هدف قرار میگیرند. درواقع اینکه "دیگر نمیتوان آنچه را با چشم دید، باور کرد" باعث میشود که ویدیوهای واقعی اهمیت خود را از دست بدهند.»

دیپفیک یا جعل عمیق در سال ۲۰۱۴ و توسط ایان گودفلو، که مدیر یادگیری ماشینی در گروه پروژههای ویژه شرکت اپل و یکی از رهبران این رشته بود، اختراع شد. این اصطلاح از ترکیب اصطلاح «یادگیری عمیق» deep learning و «جعلی» fake درست شده و درواقع شکلی از هوش مصنوعی است.

سیستم تصاویر و ویدیوهای فرد مورد نظر را با دقت زیاد بررسی میکند و میتواند رفتارها و الگوهای کلامی فرد مورد نظر را از زوایای مختلف تصویربرداری و تقلید کند.

این تکنولوژی در فصل انتخابات محبوبیت زیادی پیدا کرد که باعث شد توسعهدهندگان این تکنولوژی نگران شوند مبادا از این نرمافزار برای خدشهدار کردنِ شهرت سیاستمداران استفاده شود.

اکنون دیپفیک تام کروز با هدف سرگرمی تولید شده است. در بخشی از این ویدیوها تام کروز در مقابل دوربین زانو زده و در حالیکه به چهرهاش اشاره میکند، میگوید: «همه چیز واقعی است.» او سپس در مقابل دوربین با یک سکه تردستی انجام میدهد.

در ویدیویی دیگر او در زمین گلف ایستاده و پشتش به دوربین است او سپس عینکش را بر میدارد و میگوید: «هی گوش کنید ورزشیها و طرفداران تیکتاک، اگر از چیزی که میبینید لذت میبرید، پس منتظر باشید بعدش را ببینید.»

در یک ویدیوی دیگر او در یک فروشگاه لباس قدم میزند و یکدفعه زمین میخورد و در همان حال که دوباره روی پایش میایستد یک جوک بینالمللی درباره ملاقات با رئیسجمهور پیشین شوروی، میخاییل گورباچف، تعریف میکند.

ممکن است دیپفیکهای تام کروز باعث خنده شود، اما این تکنولوژی ترس و نگرانی کارشناسان را برانگیخته است.

یکی از کارشناسان ارشد در این زمینه، هنری آجِر، به تایمز آو لندن، گفت: «این تکنولوژی قرار نیست که از بین برود و موارد زیادی از کاربرد این تکنولوژی با اهداف بیمارگون و منفی وجود دارد.»

برخی از کارشناسان هم از این تکنولوژی تمجید کردهاند، زیرا توانسته رفتار و ظاهر این سلبریتی را به واقعیترین شکل ممکن تقلید کند. هانی فرید، استاد دانشگاه کالیفرنیا در رشته تحلیل تصاویر دیجیتالی میگوید: «بااینکه میدانستم این ویدیوها دیپفیک هستند باز هم باید بگویم "که خیلی معرکه" هستند.

فرید شاید تنها کسی باشد که از این کار تمیز شگفتزده است، راشل توباک، مدیر شرکت امنیت آنلاینِ سوشالپروف، توئیتی با این مضمون داشت که «این ویدیوها ثابت کردند که ما به مرحله تولید "دیپفیکهای غیرقابل تشخیص" رسیدهایم.»

او نوشته است: «دیپفیکها بر اعتماد عمومی اثر میگذارند، برای مجرمان و آزارگرانی که ویدیوهایشان ثبت میشود، فرصتی فراهم میکنند تا اعمال خود را لاپوشانی و انکار کنند و برای دستکاری ذهنی، تحریف، تحقیر و آزار مردم میتوان از آن استفاده کرد (کمااینکه هماکنون نیز از آنها استفاده میشود).»

۰